Nowe badania ujawniają poważne zagrożenia związane z wykorzystaniem sztucznej inteligencji w diagnostyce obrazowej. Okazuje się, że zarówno doświadczeni radiolodzy, jak i zaawansowane modele językowe AI mają trudności z odróżnieniem autentycznych zdjęć rentgenowskich od tych wygenerowanych przez algorytmy. Wyniki opublikowane w prestiżowym czasopiśmie "Radiology" wskazują na pilną potrzebę opracowania skutecznych narzędzi zabezpieczających integralność dokumentacji medycznej.

- Nowe badania opublikowane w "Radiology" ujawniają poważne zagrożenia związane z wykorzystaniem sztucznej inteligencji w diagnostyce obrazowej.

- Zarówno doświadczeni radiolodzy, jak i zaawansowane modele AI mają trudności z odróżnieniem autentycznych zdjęć rentgenowskich od tych wygenerowanych przez algorytmy.

- W eksperymencie wzięło udział 17 radiologów z 12 ośrodków w 6 krajach, którzy oceniali 264 zdjęcia rentgenowskie - połowa była autentyczna, połowa stworzona przez AI.

Termin "deepfake" kojarzy się najczęściej z fałszywymi nagraniami wideo czy zdjęciami osób publicznych, jednak coraz częściej dotyczy także obrazów medycznych. Zespół badaczy pod kierunkiem dr Mickaela Tordjmana z Icahn School of Medicine at Mount Sinai w Nowym Jorku postanowił sprawdzić, na ile eksperci i sama sztuczna inteligencja są w stanie odróżnić autentyczne zdjęcia rentgenowskie od stworzonych lub zmanipulowanych przez AI.

W eksperymencie wzięło udział 17 radiologów z 12 ośrodków w sześciu krajach: Stanach Zjednoczonych, Francji, Niemczech, Turcji, Wielkiej Brytanii i Zjednoczonych Emiratach Arabskich. Uczestnicy mieli nawet do 40 lat doświadczenia zawodowego. Ich zadaniem była ocena 264 zdjęć rentgenowskich, z których połowa była autentyczna, a połowa została wygenerowana przez sztuczną inteligencję.

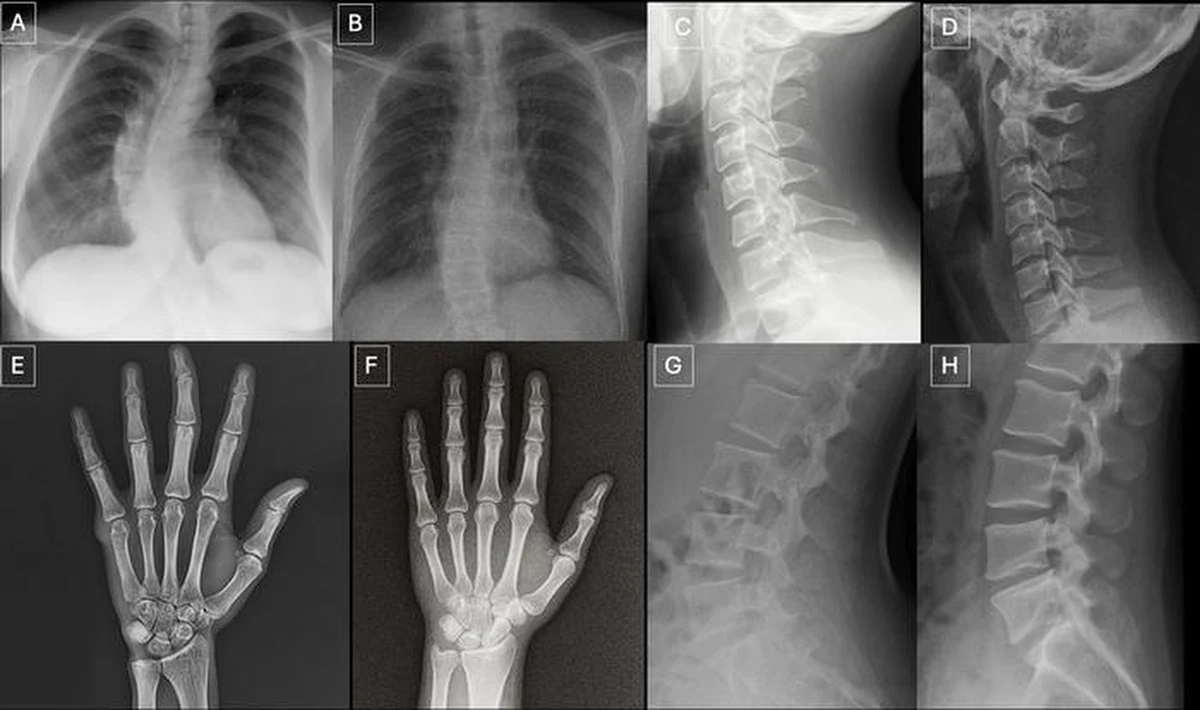

Badanie przeprowadzono na dwóch zestawach danych. Pierwszy obejmował zdjęcia różnych części ciała, zarówno prawdziwe, jak i stworzone przez model ChatGPT-4o. Drugi zestaw składał się wyłącznie z rentgenogramów klatki piersiowej, z czego połowa była autentyczna, a połowa wygenerowana przez RoentGen, model AI opracowany przez naukowców ze Stanford Medicine.

Wyniki okazały się zaskakujące. Gdy radiolodzy nie byli świadomi obecności fałszywek, jedynie 41 proc. z nich spontanicznie rozpoznało obrazy stworzone przez AI. Po poinformowaniu ich o obecności syntetycznych zdjęć, średnia skuteczność w rozróżnianiu prawdziwych i fałszywych rentgenogramów wzrosła do 75 proc. Indywidualne wyniki wahały się od 58 proc. do 92 proc.

Podobne trudności miały zaawansowane modele językowe, takie jak GPT-4o, GPT-5 (OpenAI), Gemini 2.5 Pro (Google) oraz Llama 4 Maverick (Meta). Ich skuteczność w wykrywaniu deepfake’ów mieściła się w przedziale od 57 proc. do 85 proc. Nawet model ChatGPT-4o, który był wykorzystywany do generowania fałszywych zdjęć, nie był w stanie zidentyfikować wszystkich z nich. W przypadku obrazów klatki piersiowej wygenerowanych przez RoentGen, skuteczność radiologów w wykrywaniu fałszywek wynosiła od 62 proc. do 78 proc., a modeli AI - od 52 proc. do 89 proc.

Co ciekawe, nie stwierdzono związku między doświadczeniem zawodowym radiologa a jego skutecznością w wykrywaniu syntetycznych zdjęć. Wyjątkiem byli specjaliści z zakresu radiologii układu mięśniowo-szkieletowego, którzy radzili sobie wyraźnie lepiej niż inni.

Badacze zidentyfikowali przy okazji charakterystyczne cechy fałszywek medycznych. Sztucznie wygenerowane obrazy często są "zbyt doskonałe": kości są nienaturalnie gładkie, kręgosłupy proste, płuca symetryczne, a wzory naczyń krwionośnych nadmiernie regularne. Fałszywe złamania bywają wyjątkowo czyste i ograniczone do jednej strony kości.

Eksperci ostrzegają, że tak realistyczne fałszywe obrazy rentgenowskie mogą zostać wykorzystane do fałszowania dokumentacji medycznej, co niesie poważne ryzyko zarówno dla bezpieczeństwa pacjentów, jak i dla systemu opieki zdrowotnej. W skrajnym przypadku możliwe jest nawet wywołanie chaosu przez manipulację diagnozami lub wprowadzenie zamieszania w dokumentacji szpitalnej.

Aby przeciwdziałać tym zagrożeniom, naukowcy rekomendują wdrożenie zaawansowanych zabezpieczeń cyfrowych, takich jak niewidoczne znaki wodne czy kryptograficzne podpisy powiązane z osobą technika wykonującego zdjęcie. Takie rozwiązania pozwoliłyby na jednoznaczne potwierdzenie autentyczności obrazów medycznych i utrudniłyby manipulacje.

Zdaniem dr Tordjmana, obecne wyzwania to dopiero początek. W najbliższej przyszłości można spodziewać się pojawienia się syntetycznych obrazów 3D, takich jak tomografia komputerowa czy rezonans magnetyczny. Dlatego już teraz konieczne jest tworzenie specjalnych zbiorów edukacyjnych i narzędzi do wykrywania fałszywek, aby skutecznie chronić integralność danych medycznych.